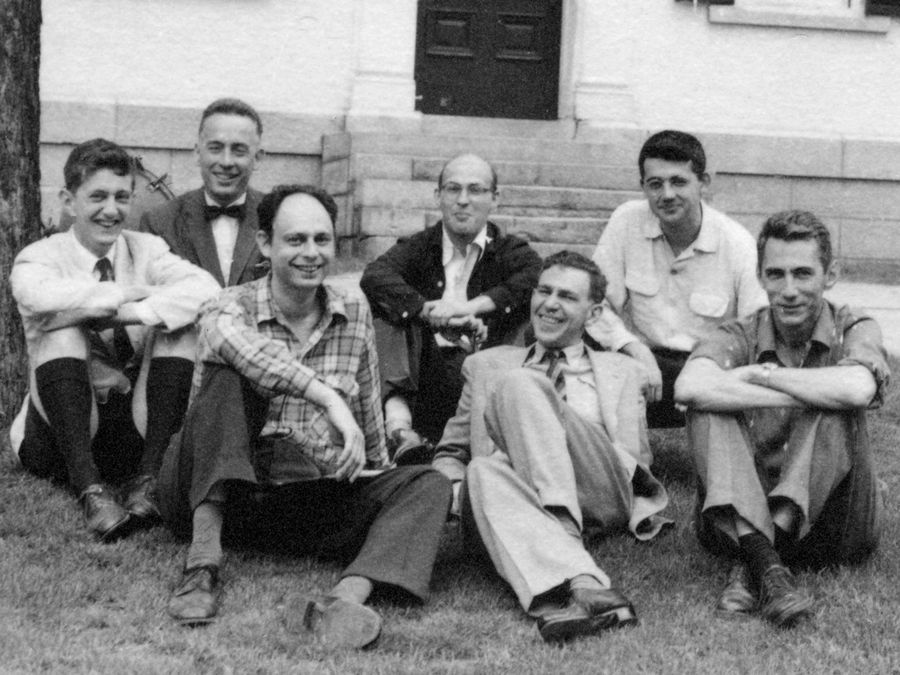

Em 1956, o cientista da computação John McCarthy cunhou um dos conceitos mais importantes do século XXI: Inteligência Artificial (IA), ou, em suas palavras, “a ciência e a engenharia de produzir máquinas inteligentes”.

Workshop de Dartmouth sobre Inteligência Artificial, 1956: marco histórico da criação da IA. John McCarthy, no canto superior direito, posa ao lado de outros pioneiros e organizadores do evento, como Marvin Minsky, Claude Shannon e Nathaniel Rochester.

A proposta original do evento, de 1955, pode ser acessada aqui

Dos primeiros sistemas de cálculo industriais aos softwares de inteligência artificial generativa, a IA impactou os diversos campos de conhecimento desde a sua criação. O avanço da IA nos últimos anos tem posto a sociedade em constante transformação. Sob a ótica da ciência como uma construção social, naturalmente, a comunicação científica também se transforma.

A IA pode potencializar a comunicação científica em seu acesso, criação e desenvolvimento. Entretanto, desafios éticos abrem discussões sobre os limites do seu uso.

Um campo em crescimento

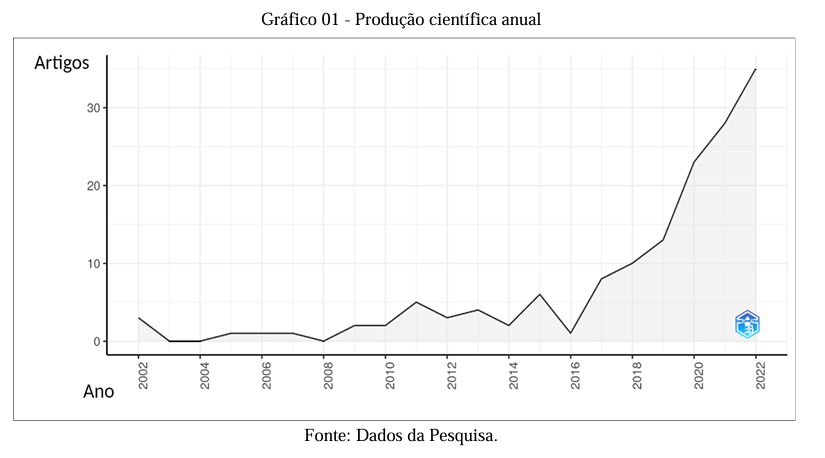

Pesquisas revelaram que a IA como tema de produções científicas tem se tornado cada vez mais frequente desde 2017, especialmente nos estudos sobre aplicação da IA na tecnologia, na comunicação científica e nas mídias sociais (Lustosa; Farias; Farias, 2024). Esse marco coincide com o surgimento do modelo Transformer de inteligência artificial (Vaswani et al., 2017), usado principalmente para o processamento de linguagem natural (PNL). Esse modelo permitiu gerar e analisar textos longos de forma rápida e eficiente. A IA mais famosa do mundo hoje, o Chat GPT é uma interface que utiliza a arquitetura Transformer. A empresa OpenAI desenvolveu esse modelo de linguagem a partir da série GPT (GPT-1, GPT-2, GPT-3, GPT-3.5 e GPT-4), que teve início em 2018, quando houve um aumento ainda maior na exploração do tema Inteligência Artificial em produções científicas.

A comunicação científica potencializada

A comunicação científica diz respeito a transferência de informações, resultados de pesquisas e inovações entre especialistas de uma determinada área, com o objetivo de disseminar conhecimentos e avanços dentro da comunidade científica (Bueno, 2010).

A inteligência artificial participa de diversas formas nesse processo, entre elas:

- Criação de conteúdo: robôs já escrevem textos com alta similaridade a textos humanos, por vezes sem diferenças perceptíveis, em velocidade muito mais alta (Zhao; Prabhashini, 2019);

- Simplificação e resumo: a IA já transforma artigos complexos em textos com linguagem simples e acessível (Zhao; Prabhashini, 2019);

- Comunicação de Riscos Ambientais: a IA pode ser aplicada na previsão e monitoramento de riscos de desastres (Ogie; Rho; Clarke, 2018);

- Análise de sentimentos: algoritmos analisam sentimentos em mídias sociais sobre temas científicos, comunicando as percepções do público para a interpretação dos dados sociais (Sánchez-Holgado; Arcila-Calderón, 2018);

- Criação multimídia: a IA facilita e acelera o processo de criação e disseminação de conteúdo multimídia;

- Combate à desinformação: IAs já são utilizadas para previsão de desinformação em sites da internet (Lustosa; Farias; Farias, 2024).

Segundo a reportagem da CNN Brasil, o sistema GeoRisk “opera com a análise de inteligência artificial, diante de uma base de dados composta por informações de características geológicas e histórico de desastres em regiões monitoradas e pelos resultados gerados pelos modelos meteorológicos utilizados pelo Cemaden”, e “visa prever situações com potencial de desencadear deslizamentos de terra com antecedência de até 72 horas”.

O potencial da IA na comunicação científica é grandioso e inegável. No entanto, há algumas preocupações fundamentais, entrando diretamente no campo da ética na ciência.

Ética na Ciência

A ascensão do uso de inteligência artificial na comunicação científica abre discussões éticas e os limites do seu uso. Tatalovic (2018) levantou a possibilidade de chatbots escreverem notícias sobre ciência. Zhao e Prabhashini (2019) apontam ferramentas que realizam o chamado “jornalismo robótico” na China. As IAs, além de escreverem textos originais e reescreverem textos já existentes, podem simplificar a linguagem de artigos científicos publicados em periódicos.

Um estudo mostrou que o ChatGPT, em 2022, já produzia resumos científicos tão convincentes que revisores humanos não conseguiram identificar a autoria por IA. Isso se mostra extremamente preocupante, especialmente porque no mesmo estudo identificaram que o software fabricou dados, incluindo números de ensaio clínico que não existiram. Tais resultados mostram que os periódicos precisam adaptar suas políticas editoriais para detectar o uso de Inteligência Artificial na criação de textos autorais (Gao, 2022).

Também entre as maiores preocupações está o estabelecimento dos limites da autoria de um texto, visto que um chatbot não atende aos critérios de autoria definidos pela Comitê de Ética em Publicações (COPE): a IA não pode assumir responsabilidade pelo conteúdo, declarar conflitos de interesse ou gerenciar direitos autorais (Ali; Djalilian, 2023).

Com IAs gerando textos com linguagem acadêmica convincente e com potencial de criação de dados falsos, a transparência dos autores é fundamental para que qualquer uso de inteligência artificial nos trabalhos científicos seja detalhado na seção de métodos. Isso se dá especialmente em um cenário em que editores poderão não conseguir distinguir conteúdos gerados por inteligência artificial. Acompanhando o avanço das IAs, é necessário que a comunidade científica estabeleça diretrizes éticas claras para preservar a transparência e confiabilidade da ciência.

Em seu artigo publicado na Revista Técnico-Científica CEJAM, Meneses (2024) propõe recomendações a autores, revisores e editores sobre integridade na aplicação de IA em comunicações científicas.

Enquanto a IA pode agilizar e potencializar a comunicação entre pesquisadores, é imprescindível atentar-se aos riscos e aos limites de seu uso, garantindo que essa tecnologia seja uma aliada da ciência.

Autor: Gabriel Marques Dias/ Mestrando PPCTE

Referências

Ali, M. J.; Djalilian, A. Readership Awareness Series – Paper 4: Chatbots and ChatGPT – Ethical Considerations in Scientific Publications. Seminars in Ophthalmology, v. 38, n. 5, p. 403–404, 2023. DOI: 10.1080/08820538.2023.2193444

Bueno, W. C. Comunicação científica e divulgação científica: aproximações e rupturas conceituais. Informação & Informação, Londrina, v. 15, p. 1-12, 2010. DOI: 10.5433/1981-8920.2010v15nesp.p1

Gao, C. A.; Howard, F. M.; Markov, N. S.; Dyer, E. C.; Ramesh, S.; Luo, Y.; Pearson, A. T. Comparing scientific abstracts generated by ChatGPT to original abstracts using an artificial intelligence output detector, plagiarism detector, and blinded human reviewers. 2022. DOI: https://doi.org/10.1101/2022.12.23.521610.

Lustosa, M. M.; FARIAS, M. G. G.; FARIAS, G. B. Inteligência Artificial e Comunicação Científica: uma revisão sistemática. Brazilian Journal of Information Science: research trends, v.18, 2024, 40 p. DOI: 10.36311/1981-1640.

Meneses, A. S. Inteligência Artificial Generativa na Comunicação Científica: recomendações para autores, revisores e editores. Rev. Tec. Cient. CEJAM, 4. ed. 2025. 13 p. DOI: https://doi. org/10.59229/2764-9806.RTCC.e202540029.

Ogie, R. I.; Rho, J. C.; Clarke, R. J. Artificial Intelligence in Disaster Risk Communication: A Systematic Literature Review. Proceedings of the 5th International Conference on Information and Communication Technologies for Disaster Management (ICT-DM 2018), p. 1–8, 2018. DOI: https://doi.org/10.1109/ICT-DM.2018.8636380

Sánchez-Holgado, P.; Arcila-Calderón, C. Towards the study of sentiment in the public opinion of science in Spanish. In: Proceedings of the 6th International Conference on Technological Ecosystems for Enhancing Multiculturality (TEEM’18), Salamanca, Espanha, 2018. p. 963–970. DOI: 10.1145/3284179.3284335

Tatalovic, M. AI Writing Bots Are about to Revolutionise Science Journalism: We Must Shape How This Is Done. Journal of Science Communication, v. 17, n. 1, 2018, 7 p. DOI: https://doi.org/10.22323/2.17010501.

Vaswani, A.; Shazeer, N.; Parmar, N.; Uszkoreit, J.; Jones, L.; Gomez, A. N.; Kaiser, Ł.; Polosukhin, I. Attention is All you Need. Advances in Neural Information Processing Systems, v. 30, 2017.